OpenAI's Pentagon-deal: Sam Altman sluit cruciaal AI-contract met technische waarborgen

BitcoinWorld

OpenAI's Pentagon-deal: Sam Altman behaalt cruciaal AI-contract met technische waarborgen

In een baanbrekende ontwikkeling voor kunstmatige intelligentie-governance kondigde OpenAI CEO Sam Altman op vrijdag 13 oktober 2025 een belangrijk defensiecontract aan met het Ministerie van Defensie, waarbij technische waarborgen zijn vastgesteld die kritieke ethische zorgen over militaire AI-toepassingen aanpakken. Deze overeenkomst volgt op een omstreden impasse tussen het Pentagon en rivaliserende AI-onderneming Anthropic, wat het complexe snijvlak benadrukt van nationale veiligheid, technologische innovatie en democratische waarden in een steeds meer geautomatiseerde wereld.

OpenAI's Pentagon-deal met technische waarborgen

Sam Altman onthulde dat OpenAI een overeenkomst heeft bereikt die het Ministerie van Defensie toegang geeft tot haar AI-modellen binnen geclassificeerde netwerken. Van belang is dat het contract specifieke technische beschermingen bevat die twee fundamentele ethische zorgen aanpakken. Ten eerste verbiedt de overeenkomst binnenlandse toepassingen voor massasurveillance. Ten tweede handhaaft het menselijke verantwoordelijkheid voor het gebruik van geweld, inclusief autonome wapensystemen. Deze waarborgen vertegenwoordigen een compromispositie tussen onbeperkte militaire toegang en volledige bedrijfsweigering.

Volgens Altman's publieke verklaring is het Ministerie van Defensie het eens met deze principes en heeft deze opgenomen in zowel wetgeving als beleid. Bovendien zal OpenAI technische waarborgen implementeren om ervoor te zorgen dat modelgedrag aansluit bij deze beperkingen. Het bedrijf zal ook ingenieurs inzetten om samen met Pentagon-personeel te werken, om een juiste modelimplementatie en voortdurende veiligheidsmonitoring te faciliteren. Deze collaboratieve aanpak onderscheidt OpenAI's strategie van meer vijandig gezinde sectorposities.

De Anthropic-impasse en ethische verdeeldheid

De OpenAI-overeenkomst komt tot stand tegen de achtergrond van mislukte onderhandelingen tussen het Pentagon en Anthropic. Gedurende meerdere maanden drongen defensiefunctionarissen er bij AI-bedrijven op aan om hun modellen te laten gebruiken voor "alle rechtmatige doeleinden". Anthropic zocht echter expliciete beperkingen op massale binnenlandse surveillance en volledig autonome wapens. CEO Dario Amodei voerde aan dat AI in specifieke gevallen democratische waarden zou kunnen ondermijnen in plaats van verdedigen.

Deze ethische houding trok aanzienlijke steun van technologiemedewerkers. Meer dan 60 OpenAI-medewerkers en 300 Google-medewerkers ondertekenden een open brief ter ondersteuning van Anthropic's positie. De brief riep op tot sectorwijde adoptie van vergelijkbare ethische grenzen, wat een groeiende bezorgdheid weerspiegelt onder AI-ontwikkelaars over potentiële militaire toepassingen van hun technologieën.

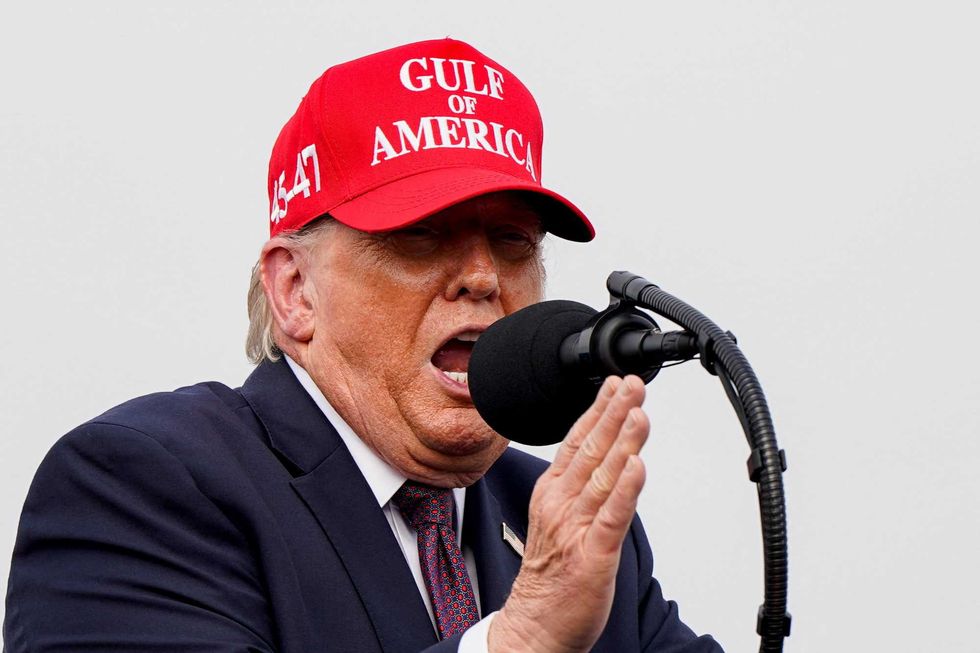

Het meningsverschil escaleerde tot een publieke confrontatie met de Trump-regering. President Donald Trump bekritiseerde Anthropic als "linkse gekken" in een bericht op sociale media. Hij droeg federale agentschappen op om de producten van het bedrijf binnen zes maanden uit te faseren. Defensieminister Pete Hegseth intensiveerde het conflict verder door Anthropic aan te wijzen als een toeleveringsketenrisico. Deze aanwijzing verbiedt aannemers en partners die zaken doen met het leger om commercieel met Anthropic om te gaan.

Sectorimplicaties en regelgevingslandschap

De contrasterende uitkomsten voor OpenAI en Anthropic onthullen aanzienlijke implicaties voor de AI-sector. Bedrijven moeten nu complexe relaties met overheidsinstanties navigeren terwijl ze ethische normen en publiek vertrouwen handhaven. OpenAI's aanpak toont aan dat onderhandelde overeenkomsten met specifieke waarborgen een haalbare weg voorwaarts vertegenwoordigen. Omgekeerd toont Anthropic's ervaring de potentiële gevolgen van het innemen van een stevigere ethische houding tegen overheidseisen.

Deze situatie vindt plaats binnen een bredere regelgevingscontext. Meerdere landen ontwikkelen kaders voor militaire AI-toepassingen. De Verenigde Naties heeft lopende discussies gevoerd over dodelijke autonome wapensystemen. Bovendien heeft de Europese Unie onlangs haar AI-wetgeving geïmplementeerd, die specifieke bepalingen bevat voor hoogrisicoanalyses. Deze mondiale ontwikkelingen creëren een steeds complexere omgeving voor AI-bedrijven die actief zijn in defensiesectoren.

Technische implementatie en veiligheidsprotocollen

OpenAI's overeenkomst omvat verschillende technische componenten die zijn ontworpen om naleving van ethische waarborgen te waarborgen. Volgens Fortune-verslaggever Sharon Goldman informeerde Altman medewerkers dat de overheid OpenAI zal toestaan om haar eigen "veiligheidsstack" te bouwen om misbruik te voorkomen. Deze technische infrastructuur vertegenwoordigt een kritieke component van de overeenkomst. Bovendien, als een OpenAI-model weigert een specifieke taak uit te voeren, kan de overheid het bedrijf niet dwingen het gedrag van het model te wijzigen.

Deze technische maatregelen pakken kernzorgen aan over de betrouwbaarheid en afstemming van AI-systemen. Ze bieden mechanismen om ervoor te zorgen dat AI-gedrag binnen vastgestelde ethische grenzen blijft. De inzet van OpenAI-ingenieurs om direct met Pentagon-personeel samen te werken faciliteert juiste implementatie en voortdurende monitoring. Dit collaboratieve technische toezicht vertegenwoordigt een innovatieve benadering van militair-zakelijke partnerschappen in gevoelige technologiedomeinen.

Vergelijking van AI-bedrijfsbenaderingen voor militaire contracten| Bedrijf | Positie | Belangrijkste waarborgen | Overheidsreactie |

|---|---|---|---|

| OpenAI | Onderhandelde overeenkomst | • Geen binnenlandse massasurveillance • Menselijke verantwoordelijkheid voor geweld • Technische waarborgen • Inzet van ingenieurs | Contract toegekend met waarborgen |

| Anthropic | Ethische beperkingen | • Geen massasurveillance • Geen autonome wapens • Bescherming van democratische waarden | Aanwijzing als toeleveringsketenrisico Uitfasering van producten gelast |

Bredere context en internationale ontwikkelingen

De OpenAI-Pentagon-overeenkomst valt samen met belangrijke internationale ontwikkelingen. Kort na Altman's aankondiging kwam nieuws naar buiten over Amerikaanse en Israëlische militaire acties tegen Iran. President Trump riep op tot de omverwerping van de Iraanse regering. Deze gelijktijdige ontwikkelingen benadrukken het complexe geopolitieke landschap waarin militaire AI-technologieën worden ingezet. Ze onderstrepen ook de tijdigheid van ethische overwegingen rondom autonome systemen en surveillancemogelijkheden.

Wereldwijd volgen landen verschillende benaderingen voor militaire AI-integratie:

- China heeft agressief militaire AI-toepassingen nagestreefd met minder publieke ethische beperkingen

- Rusland heeft autonome systemen ingezet in conflictgebieden met beperkte transparantie

- Europese landen hebben over het algemeen voorzichtigere benaderingen aangenomen met strenger toezicht

- Verenigde Naties discussies gaan door over potentiële verdragen over autonome wapens

Deze internationale context creëert concurrentiedruk die binnenlandse beleidsbeslissingen beïnvloedt. De Verenigde Staten staan voor de uitdaging om technologische superioriteit te behouden terwijl ze democratische waarden en ethische normen hooghouden. De OpenAI-overeenkomst vertegenwoordigt één benadering om deze concurrerende prioriteiten in balans te brengen.

Perspectieven van medewerkers en sectorethiek

De open brief ondertekend door honderden AI-medewerkers onthult aanzienlijke interne sectorspanningen. Technologiemedewerkers bevragen steeds vaker de ethische implicaties van hun werk, met name met betrekking tot militaire toepassingen. Dit activisme van medewerkers vertegenwoordigt een relatief nieuw fenomeen in de defensietechnologiesector. Historisch gezien ondervonden defensieaannemers minder interne weerstand tegen militaire toepassingen. AI-bedrijven trekken echter medewerkers aan met sterke ethische overtuigingen over de maatschappelijke impact van technologie.

Deze dynamiek creëert managementuitdagingen voor AI-bedrijven die defensiecontracten nastreven. Leiderschap moet overheidsrelaties, zakelijke kansen en zorgen van medewerkers in evenwicht brengen. OpenAI's benadering om specifieke waarborgen te onderhandelen vertegenwoordigt één strategie om deze concurrerende druk aan te pakken. De bereidheid van het bedrijf om publiekelijk te pleiten voor sectorwijde adoptie van vergelijkbare voorwaarden suggereert een poging om ethische normen te vestigen terwijl overheidstoegang behouden blijft.

Juridische en beleidsimplicaties

De Anthropic-aanwijzing als toeleveringsketenrisico roept aanzienlijke juridische vragen op. Het bedrijf heeft verklaard dat het een dergelijke aanwijzing voor de rechter zal aanvechten. Deze potentiële rechtszaak zou belangrijke precedenten kunnen vestigen met betrekking tot overheidsautoriteit om commerciële relaties te beperken op basis van bedrijfsethische posities. De uitkomst kan van invloed zijn op hoe andere AI-bedrijven vergelijkbare onderhandelingen met overheidsinstanties benaderen.

Beleidsexperts merken verschillende belangrijke overwegingen op:

- De balans tussen nationale veiligheidsbehoeften en zakelijke ethische autonomie

- De passende rol van technische waarborgen in militaire AI-systemen

- De mechanismen om naleving van ethische beperkingen te waarborgen

- De internationale implicaties van verschillende nationale benaderingen

Deze beleidsvragen zullen in de komende maanden waarschijnlijk meer aandacht krijgen. Congrescommissies hebben al hoorzittingen over militaire AI-ethiek aangekondigd. Bovendien ontwikkelen meerdere denktanks en onderzoeksinstellingen beleidskaders voor verantwoorde militaire AI-inzet.

Conclusie

OpenAI's Pentagon-deal met technische waarborgen vertegenwoordigt een belangrijke mijlpaal in militaire AI-integratie. De overeenkomst toont aan dat onderhandelde benaderingen met specifieke ethische beschermingen overheidstoegang kunnen faciliteren terwijl legitieme zorgen worden aangepakt. De contrasterende ervaring met Anthropic onthult echter voortdurende spanningen tussen nationale veiligheidsprioriteiten en zakelijke ethische normen. Naarmate AI-technologieën zich blijven ontwikkelen, zullen deze complexe relaties zorgvuldige navigatie vereisen. De technische waarborgen die in OpenAI's overeenkomst zijn vastgesteld, kunnen dienen als model voor toekomstige militair-zakelijke partnerschappen. Uiteindelijk zal het evoluerende landschap van militaire AI-toepassingen voortdurende dialoog vereisen tussen overheidsinstanties, technologiebedrijven, medewerkers en het maatschappelijk middenveld om verantwoorde innovatie te waarborgen die zowel veiligheid als democratische waarden beschermt.

Veelgestelde vragen

V1: Welke specifieke waarborgen omvat OpenAI's Pentagon-deal?

De overeenkomst verbiedt binnenlandse toepassingen voor massasurveillance en handhaaft menselijke verantwoordelijkheid voor het gebruik van geweld, inclusief autonome wapensystemen. OpenAI zal technische waarborgen implementeren en ingenieurs inzetten om naleving te waarborgen.

V2: Waarom zijn Anthropic's onderhandelingen met het Pentagon mislukt?

Anthropic zocht expliciete beperkingen op massale binnenlandse surveillance en volledig autonome wapens, terwijl het Pentagon aandrong op toegang voor "alle rechtmatige doeleinden". Dit fundamentele meningsverschil verhinderde een onderhandelde overeenkomst.

V3: Welke gevolgen heeft Anthropic ondervonden voor haar ethische houding?

President Trump beval federale agentschappen om Anthropic-producten uit te faseren, en Defensieminister Hegseth wees het bedrijf aan als een toeleveringsketenrisico, waardoor militaire aannemers verboden werden om zaken met hen te doen.

V4: Hoe hebben medewerkers in de AI-sector op deze ontwikkelingen gereageerd?

Meer dan 360 medewerkers van OpenAI en Google ondertekenden een open brief ter ondersteuning van Anthropic's ethische positie, wat aanzienlijke interne bezorgdheid over militaire AI-toepassingen weerspiegelt.

V5: Welke bredere implicaties heeft deze situatie voor AI-governance?

De contrasterende uitkomsten benadrukken de complexe balans tussen nationale veiligheid, zakelijke ethiek en technologische innovatie, wat mogelijk van invloed is op hoe andere landen en bedrijven militaire AI-integratie benaderen.

Deze post OpenAI's Pentagon Deal: Sam Altman Secures Crucial AI Contract with Technical Safeguards verscheen voor het eerst op BitcoinWorld.

Misschien vind je dit ook leuk

'Ziek': MAGA geschokt nadat peiler onthult dat Trump-administratie actie onderneemt voorafgaand aan militaire operatie

Bitcoin is met 48% gedaald, maar de grootste kopers uit de geschiedenis blijven accumuleren